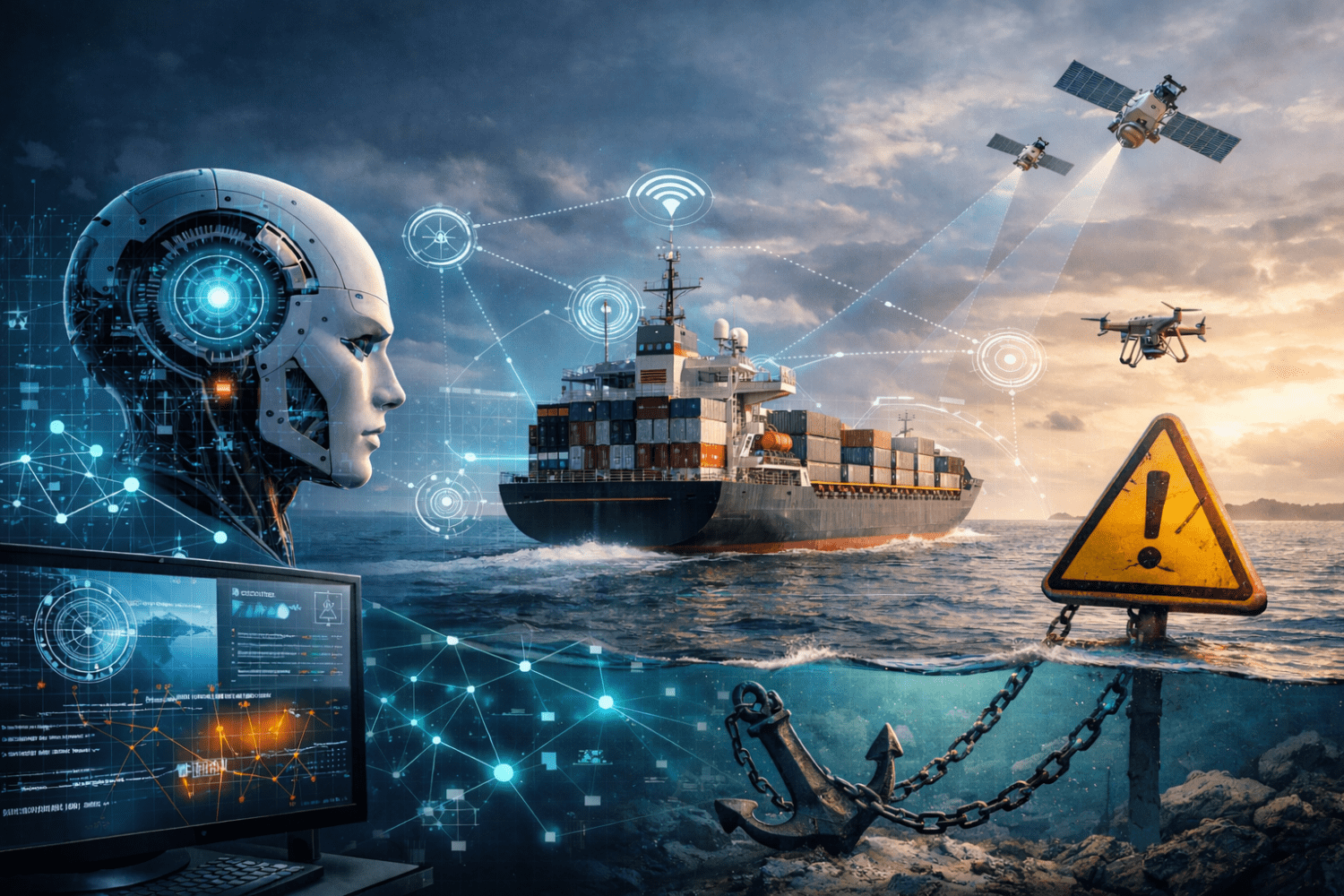

Alors que la puissance de calcul des algorithmes s’envole, l’autonomie des navires semble marquer le pas. Retard technologique ou sagesse opérationnelle ? Dans cette analyse, nous explorons pourquoi le monde maritime choisit de lier la performance à la responsabilité humaine et à la souveraineté des données. Un plaidoyer pour une « lucidité stratégique » face au mirage de l’automatisation intégrale.

IA maritime : les raisons structurelles d’une autonomie encadrée

L’intelligence artificielle est désormais pleinement intégrée aux systèmes maritimes. Navigation assistée, optimisation énergétique, maintenance prédictive, gestion de flotte, surveillance du trafic ou analyse post incident ne relèvent plus de l’expérimentation marginale. Ces technologies sont déjà à l’oeuvre, souvent de manière invisible, dans le fonctionnement quotidien des navires et des centres de contrôle à terre.

Pourtant, un constat s’impose aux acteurs du secteur : la performance des algorithmes progresse plus vite que l’autonomie réelle des systèmes maritimes. Cette dissociation alimente régulièrement le débat sur un supposé retard du maritime. Une lecture plus attentive montre au contraire que cette progression maîtrisée est le produit d’une double contrainte structurante : la responsabilité et la souveraineté.

Un système critique à forte densité normative

Le maritime constitue un système socio technique global opéré dans des environnements ouverts, soumis à l’incertitude et régi par un cadre réglementaire international dense, notamment porté par l’Organisation maritime internationale. Les décisions prises en mer engagent directement la sécurité des équipages, la protection de l’environnement, la continuité des échanges économiques mondiaux et, dans certains cas, la souveraineté des États.

Historiquement, l’innovation maritime s’est toujours déployée par paliers successifs. Les grandes ruptures technologiques ont été intégrées de manière incrémentale, sous contrainte de certification, d’acceptabilité opérationnelle et de responsabilité clairement attribuable. Radar, GPS, ECDIS ou AIS n’ont jamais été conçus pour remplacer le jugement humain, mais pour en augmenter la capacité face à l’incertitude.

L’intelligence artificielle modifie profondément cet équilibre en intervenant non plus seulement sur la perception ou le calcul, mais sur la structuration même des choix opérationnels.

De l’aide technique à l’architecture décisionnelle

Les systèmes actuels d’IA maritime hiérarchisent des options, arbitrent entre des critères multiples et parfois contradictoires, et proposent des recommandations optimisées. Dans de nombreux cas, l’opérateur humain n’élabore plus directement la décision. Il la valide, la corrige

ou la suspend. Son rôle se déplace vers la supervision d’un espace décisionnel largement pré structuré par des algorithmes.

Ce glissement est central. Il ne signifie pas la disparition de l’humain, mais une transformation de sa fonction. L’humain devient garant de la décision, responsable de sa légitimité et de sa justification a posteriori. Or cette position suppose une compréhension fine des hypothèses implicites des systèmes, de leurs limites et de leurs conditions de validité.

Le regard assurantiel, révélateur du risque systémique

Cette transformation est particulièrement visible du point de vue des assureurs. Les analyses récentes de Allianz Global Corporate & Specialty classent désormais la numérisation, l’intelligence artificielle et le risque cyber parmi les menaces majeures pour la marine marchande, au même niveau que les collisions, les avaries ou les événements climatiques extrêmes.

Ce signal est révélateur d’un basculement. Les incidents maritimes ne sont plus uniquement matériels. Ils sont de plus en plus liés à des défaillances combinées : altération de données, désynchronisation entre systèmes embarqués et systèmes à terre, biais d’apprentissage, erreurs de paramétrage ou perte de vigilance humaine face à des recommandations jugées fiables.

Dans ces environnements fortement automatisés, le risque principal n’est pas la panne franche, mais la dégradation progressive de la fiabilité, difficilement détectable en temps réel. L’illusion de maîtrise devient alors un facteur de vulnérabilité.

Responsabilité et souveraineté des données : un verrou stratégique

À cette contrainte de responsabilité s’ajoute une seconde ligne de tension, plus structurelle encore : la souveraineté des données maritimes. L’intelligence artificielle repose sur l’accès à des volumes massifs de données issues des navires, des ports, des systèmes de navigation et des plateformes de gestion de flotte. Ces données constituent une ressource stratégique.

Lorsque les algorithmes d’aide à la navigation, d’optimisation des routes ou de gestion du trafic sont conçus, entraînés et maintenus par un nombre restreint d’acteurs technologiques globaux, la dépendance ne porte plus seulement sur des outils logiciels. Elle concerne la manière même dont les situations sont interprétées, hiérarchisées et traduites en recommandations opérationnelles.

Cette concentration des capacités algorithmiques pose une question rarement formulée explicitement : que devient l’indépendance opérationnelle des pavillons nationaux lorsque les arbitrages critiques sont largement conditionnés par des modèles conçus hors de leur sphère de contrôle ? Dans un contexte de tensions géopolitiques et de sécurisation accrue des flux maritimes, cette souveraineté cognitive devient un enjeu central.

Fracture numérique et asymétries économiques

Cette dynamique accentue également la fracture numérique au sein du secteur maritime. Les grands armateurs, dotés de flottes étendues et de systèmes numériques intégrés, alimentent des boucles d’apprentissage vertueuses et participent à façonner les standards algorithmiques. Les acteurs plus petits ou spécialisés contribuent peu à ces corpus de données tout en devenant dépendants des modèles qui en sont issus.

Le risque est celui d’un maritime à deux vitesses, où l’accès différencié aux outils d’aide à la décision basés sur l’IA devient un facteur de concentration économique et de fragilisation de la gouvernance collective du risque.

Une lenteur qui relève de la lucidité

La progression maîtrisée de l’autonomie maritime ne traduit ni un retard technologique ni une résistance au changement. Elle révèle une lucidité stratégique propre aux systèmes critiques. Tant que les décisions devront être justifiées, tant que la responsabilité restera humaine, tant que la donnée maritime constituera un levier de souveraineté, l’autonomie algorithmique restera encadrée.

À ce titre, le maritime n’est pas en retrait. Il est en avance sur la gouvernance de l’intelligence artificielle. Il montre que la question centrale n’est pas celle de la performance des algorithmes, mais celle de la légitimité de la décision dans des systèmes à haut niveau de risque.

Là où les algorithmes progressent vite, la confiance se construit lentement. Dans le maritime, cette lenteur n’est pas un frein. C’est une condition de soutenabilité.